Scrum Guide 問世至今已經超過 15 年。到了 GenAI 與 coding agents 時代,Scrum 算不算過時?

我覺得,這個問題不能只用「過不過時」來看。真正值得看的是:當 AI 已經能查 repo、寫 ticket、開 PR、跑測試之後,Agile 裡哪些工作真的被改寫了,哪些其實沒有。

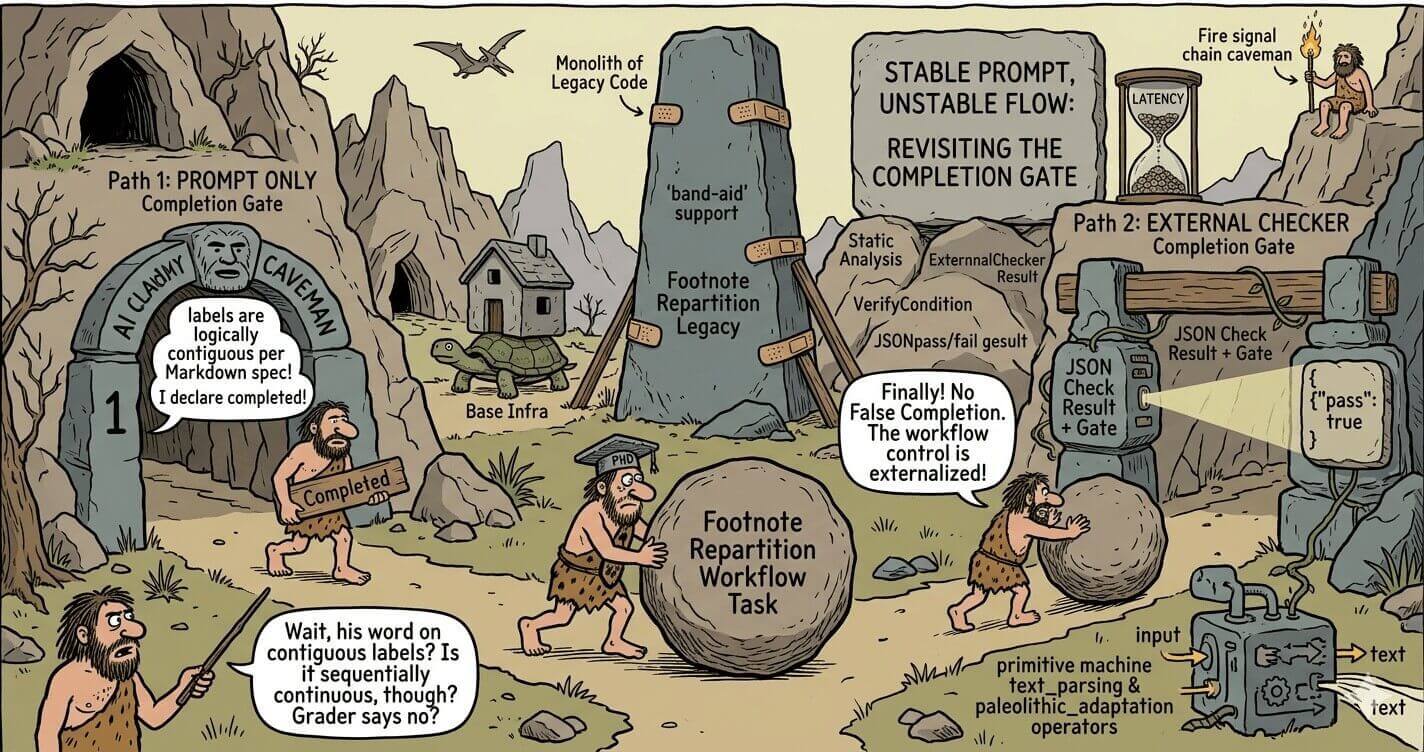

現在很多團隊碰到的情況,不是工作自動做完了,而是塞車的位置換了。

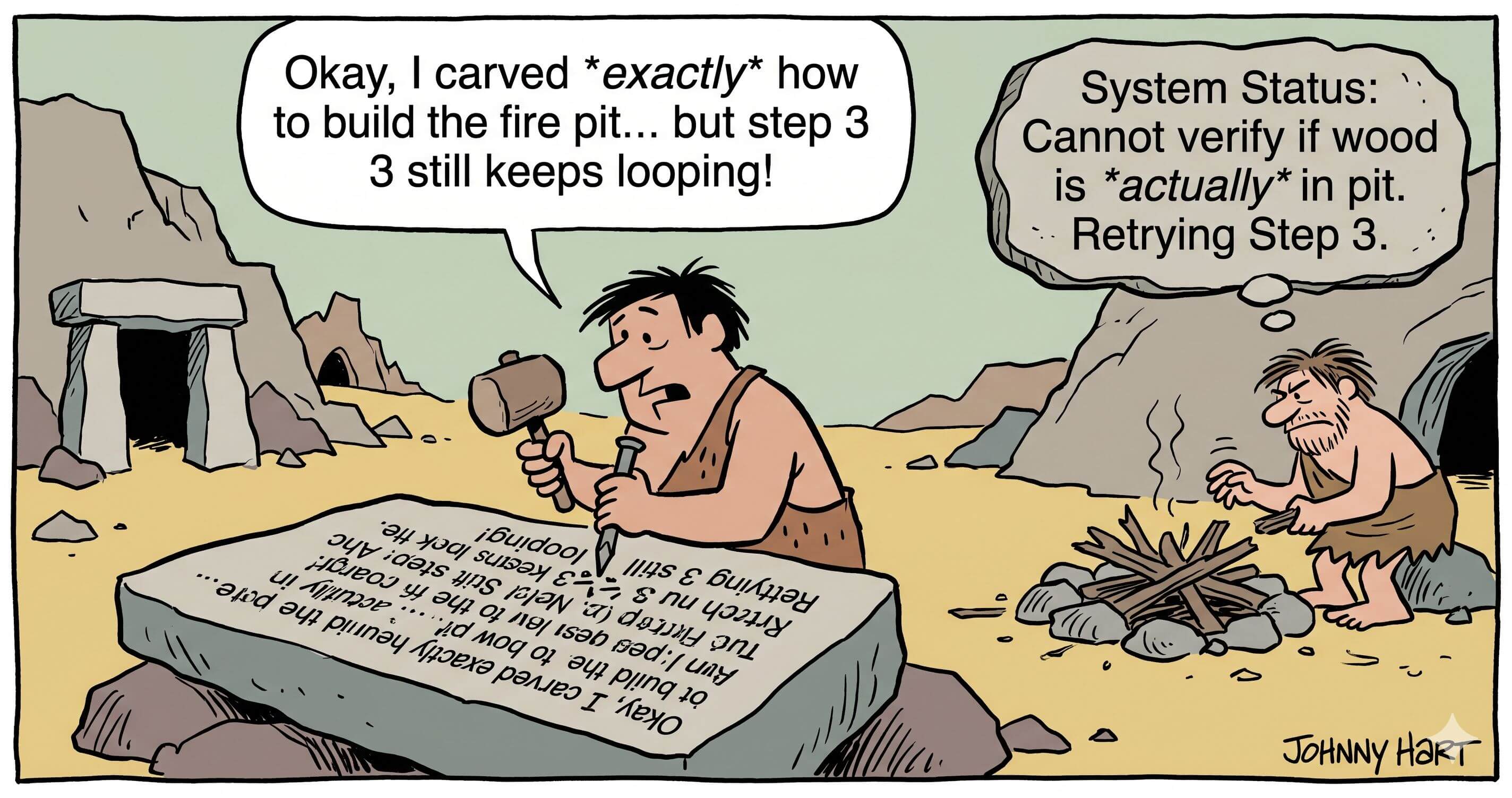

你讓 agent 跑了一整晚。隔天早上,GitHub 上可能已經躺著幾個待 review 的 PR、兩三種看起來都說得通的重構方向、一些測試全綠燈卻仍讓人隱隱不安的修改,外加幾個碰了系統邊界卻未必自知的變更。 OpenClaw(龍蝦)作者 Peter Steinberger 也提過,自己曾讓系統跑上數小時,甚至隔夜處理重構;他甚至認為 “prompt requests” 也會變成新的日常。

這裡真正變快的,是程式碼產出。沒有一起變快的,則是審查、驗收、風險辨識、責任承擔和後續決策。表面上看起來像是寫得更快,實際上常常只是把瓶頸往後推。

瓶頸既然換了位置,接下來要重看的,就不只是 Scrum 還在不在,而是整個協作方式要怎麼調整。譬如說,很多原本得靠人類口頭交換的內容,現在可以先由機器整理、摘要、比對、補齊,甚至先展開幾種可能方案。

很多人在正式會議前,本來就會先和 AI 討論,再把整理過的結論帶進會議。既然這件事早就在發生,那差別往往只剩下:團隊要不要正式承認它。說穿了,就是要不要把那隻早就在場外跑著的龍蝦,正式接進協作流程裡。

我甚至還有個瘋狂的想法。何不開一個視窗,接上麥克風與喇叭,邀請這位 AI 本尊直接進來會議現場,說不定反而更有效率,也更有火花呢。

還有哪些需要調整的呢?